Generative AI sicher und praxisnah: Automatisierte Ticketanalyse in der AWS Cloud

Wiederkehrende manuelle Aufgaben binden in vielen IT-Abteilungen Zeit und qualifizierte Ressourcen – besonders im Bereich IT-Sicherheit. So erzeugen Schwachstellenscanner regelmäßig neue Einträge in zentralen Ticket-Systemen wie JIRA oder ServiceNow. Die manuelle Sichtung und Einordnung dieser Tickets sind aufwändig, fehleranfällig und kaum skalierbar.

In einem aktuellen Kundenprojekt haben wir gezeigt, wie Generative AI (GenAI) jenseits klassischer Chatbots eingesetzt werden kann – zur intelligenten Automatisierung realer Geschäftsprozesse. Der Fokus: Sicher, cloudbasiert und kompatibel mit den Anforderungen öffentlicher Organisationen.

RAG, Embeddings & AWS: Der technologische Ansatz

Herzstück der Lösung ist ein sogenannter Retrieval-Augmented Generation (RAG) Ansatz. Dabei werden neue Inhalte – in unserem Fall: Tickettexte und Inhalte – mit bestehenden, bereits beurteilten Einträgen abgeglichen. Ziel ist es, semantisch ähnliche Tickets automatisch zu erkennen und Folgeaktionen abzuleiten.

Dazu werden sogenannte Embeddings verwendet: Textinhalte werden in mathematische Vektoren übersetzt, die es ermöglichen, Bedeutungsähnlichkeiten rechnerisch zu vergleichen. Vektoren kann man sich hier genau wie in der Schule vorstellen, nur dass sie nicht 2 oder 3 Dimensionen, sondern 256 Dimensionen umfassen. Das ist besonders hilfreich, wenn gleiche Inhalte unterschiedlich formuliert sind.

Unsere Lösung basiert vollständig auf Services aus der AWS-Region Frankfurt. Zum Einsatz kommen u. a.:

- Amazon Bedrock (Titan) zur Erzeugung der Embeddings. Titan ist ein von AWS trainiertes Large Language Model (LLM), das relativ kompakt und damit schnell und günstig ist. Es läuft auch vollständig in der AWS-Region Frankfurt. Automatische Drift Detection sorgt dafür, dass Code und Infrastruktur immer synchron bleiben. Keine manuelle Nacharbeit erforderlich.

- PostgreSQL mit Vektor-Erweiterung (auf Aurora Serverless v2) für den semantischen Abgleich

- AWS Lambda und SNS zur Orchestrierung der Datenflüsse

Ein besonderer Vorteil von Aurora Serverless v2: Die Datenbank skaliert automatisch mit der Last – und reduziert sich bei Inaktivität sogar auf null. Das spart Kosten und macht die Lösung besonders wirtschaftlich für volatile Nutzungsmuster wie Tickets, die oft gesammelt an JIRA übertragen werden.

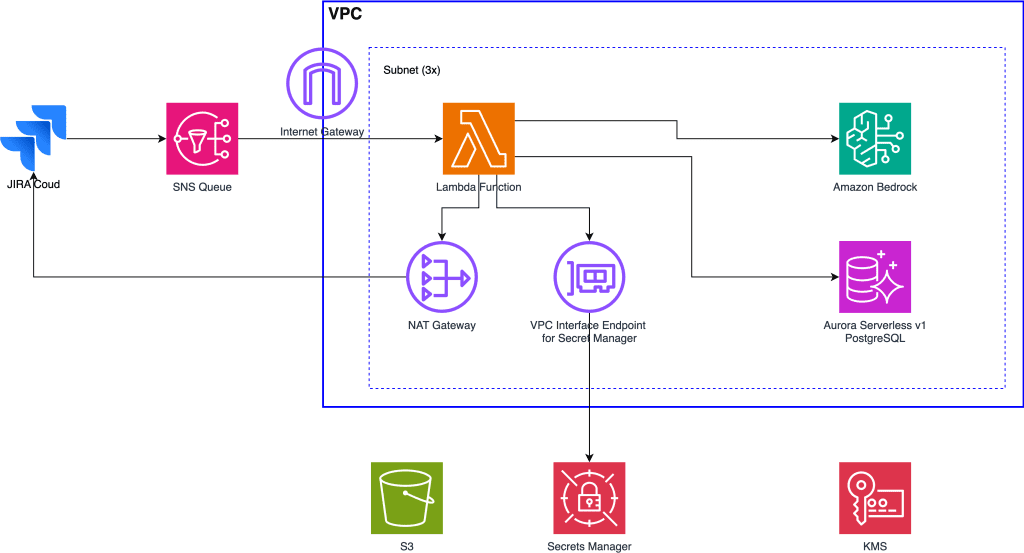

Architekturdiagramm der automatisierten Ticket-Analyse

Kern ist eine Lambda-Funktion, die über JIRA Automations über eine SNS-Queue aufgerufen wird. Diese wiederum ruft Amazon Bedrock für die Inferenz auf und speichert die Daten in einer Aurora Serverless PostgreSQL ab. Das Datenbank-Passwort liegt in dem Secrets Manager. Der KMS verwaltet einen Schlüssel, um die Dateien „at rest“ mit einem individuellen Schlüssel zu sichern. S3 wird vor allem für das Provisionieren der Lambda-Funktion und des dazugehörigen Layers verwendet.

Intelligente Ticketzuordnung im Praxisbetrieb

Unser Kunde – ein großer globaler Konzern mit hohem IT Fokus – hatte ein klares Ziel: Die Bewertung und Weiterleitung sicherheitsrelevanter Tickets müssen effizienter werden. Gemeinsam mit dem IT-Team haben wir ein KI-gestütztes System entwickelt , das neue Schwachstellen-Tickets analysiert, mit bestehenden vergleicht und automatisch einem verantwortlichen Team zuordnet.

Die Vorteile liegen auf der Hand:

- Zeitersparnis: Die manuelle Durchsicht entfällt für einen Großteil der Tickets.

- Konsistenz: Ähnliche Tickets werden gleichbehandelt – unabhängig von Tagesform oder Zuständigkeit.

- Compliance: Die Lösung erfüllt die Anforderungen der kundenspezifischen Unternehmensrichtlinie zum Umgang mit KI vollumfänglich– insbesondere da KI nicht zur Generierung von Inhalten verwendet wird, sondern nur zum Abgleich der Tickets.

Das System läuft vollständig in der AWS Cloud und erfüllt höchste Datenschutzanforderungen – ein wichtiger Punkt für Unternehmen im öffentlichen Sektor.

Business Case: Mehrwert mit gesundem Menschenverstand

Die technische Lösung ist schlank – der wirtschaftliche Nutzen klar messbar.

Ein kurzes Rechenbeispiel für eines der zahlreichen IT-Teams im Konzern:

- Ein IT-Mitarbeiter mit 70.000 € Jahresgehalt verbringt 4 Stunden pro Woche mit manueller Ticketbewertung.

- Das entspricht ca. 5.800 € pro Jahr.

- Im Vergleich dazu: Die eingesetzten AWS-Dienste verursachen monatliche Betriebskosten von unter 5 € – also rund 60 € im Jahr. Die Kosten sind deswegen so niedrig, weil konsequent auf serverlose Dienste (serverless services) gesetzt wird.

Fazit: Die Investition in GenAI lohnt sich bereits bei kleineren Fallzahlen. Skaleneffekte steigern die Einsparungen zusätzlich.

Fazit und Ausblick

Generative AI ist mehr als ein Chatbot. Sie hilft Unternehmen, reale Herausforderungen automatisiert zu lösen – sicher, skalierbar und nachvollziehbar. Wir bei PROTOS Technologie setzen auf Cloud-native Architekturen, modulare Services und höchste Datenschutzstandards.

Der nächste Schritt: Die Lösung produktiv einsetzen und auf weitere Prozesse ausrollen – etwa in den Bereichen Instandhaltung, Incident Management oder Kundenservice.